3D-Punktwolken

Ermöglicht es einem Roboter, sich sicher durch unbekannte und potenziell gefährliche 3D-Umgebungen zu bewegen

In diesem Artikel:

- 3D-Punktwolken-Stitching verbessert die Roboternavigation: Waygate Technologies entwickelte eine 3D-Laser-Punktwolken-Stitching-Lösung, die es autonomen Robotern ermöglicht, sicher durch komplexe und gefährliche industrielle Umgebungen zu navigieren

- Umgebungskartierung in Echtzeit: Das System erfasst kontinuierlich 3D-Laserscans und fügt sie zu einer zusammenhängenden Punktwolke zusammen, wodurch ein detaillierter digitaler Zwilling der Umgebung des Roboters für eine präzise Wegplanung entsteht.

- Verbesserte Sicherheit in engen Räumen: Durch die präzise Raumwahrnehmung verringert die Technologie das Risiko von Kollisionen und erhöht die Betriebssicherheit in beengten oder unbekannten Umgebungen.

- Unterstützt autonome und ferngesteuerte Operationen: Die zusammengesetzten Punktwolkendaten ermöglichen sowohl die autonome Navigation als auch die Fernsteuerung durch den Bediener und sind damit ideal für Inspektionen in unzugänglichen oder gefährlichen Bereichen.

- Skalierbar für industrielle Anwendungen: Diese Technologie kann in verschiedenen Branchen eingesetzt werden, z. B. in der Öl- und Gasindustrie, der Energieerzeugung und der Infrastruktur, wo robotergestützte Inspektion und Kartierung von entscheidender Bedeutung sind.

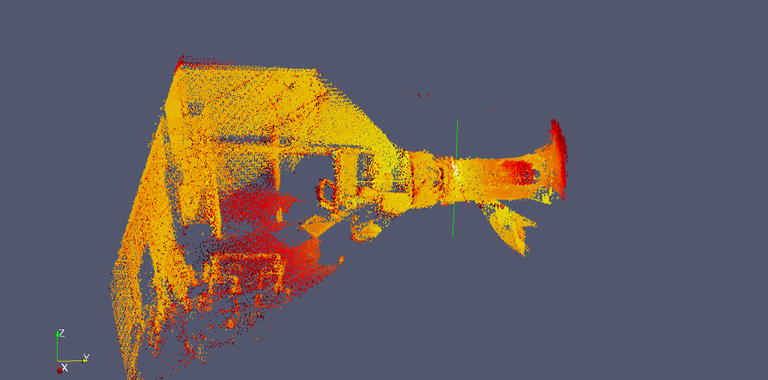

3D-Umgebungsvisualisierung

Der Roboter trägt einen rotierenden 3D-Laserentfernungsmesser (speziell für diese Anwendung entwickelt). Die Laserdaten, die aus 3D-Punktwolken bestehen, werden an einen Steuerungs-PC übertragen, wo sie verarbeitet werden. Bei der Verarbeitung werden neue Daten mit zuvor erfassten Punkten so abgeglichen, dass eine kohärente Punktwolke entsteht, die die Umgebung korrekt wiedergibt. Auf dem PC ermöglicht eine Viewer-Anwendung dem Bediener, diese Darstellung auf bequeme Weise zu beobachten.

Punktwolke

Der 3D-Laserentfernungsmesser erstellt eine Punktwolke der Umgebung. Durch Bewegen des Roboters werden mehrere Punktwolken aus verschiedenen Positionen erstellt. Dies ergibt eine "dichtere" Punktwolke mit mehr Informationen.

Sensor-Daten

Robotersensordaten wie IMU (Trägheitsmesseinheit) und Encoderdaten (Radumdrehungen) werden dem Modell als zusätzliche Informationsquelle hinzugefügt.

Datenverarbeitung

Fortschrittliche Algorithmen verarbeiten alle Daten aus der zusammengesetzten Punktwolke und den Sensordaten an Bord, um die genaue Position im 3D-Raum zu berechnen.

Wie es funktioniert

Das Navigationssystem hat eine modulare Architektur. Dies ist vor allem durch die Verwendung von Ethernet für die Kommunikation möglich. Je nachdem, welche Module montiert / verwendet werden, kann der Navigationsfilter auf dem PC-Computer eine bessere oder eher grobe Lokalisierungsabschätzung liefern. Die Software-Architektur basiert auf individuell kodierten Modulen, die über prozessübergreifende Kanäle kommunizieren, um Informationen auszutauschen.

Implementierte Module

- Die Motorsteuerungssoftware (einschließlich des Navigationsfilters)

- Der Laserpunktwolkenprozessor

- Das 3D-Visualisierungsmodul

- Das Videoaufnahme- und -wiedergabemodul

Kommunikation

Die Navigationsmodule kommunizieren über Ethernet mit einem Steuer-PC. Die Daten werden von einer Software direkt auf dem PC ausgewertet. Die Software zur Steuerung des Roboters läuft ebenfalls auf dem PC und sendet Bewegungsbefehle über Ethernet an die eingebauten Motorsteuerungen.

Kontaktieren Sie uns

Finden Sie heraus, wie unsere Produkte und Dienstleistungen Ihrem Unternehmen helfen können. Fragen Sie einen unserer Vertriebsmitarbeiter oder stellen Sie unseren technischen Experten Fragen.